O exemplo atual mais conhecido do uso do reconhecimento de voz está nos assistentes pessoais inteligentes, capaz de realizar diversas tarefas para seus usuários, como trazer informações do trânsito e da meteorologia, agenda de compromissos, preços de produtos, sugestões de locais para comprar e passear etc.

Você pode usar o teclado para interagir com os assistentes, mas quase todos já têm recursos de reconhecer voz como forma extra de interação. São exemplos de assistentes pessoais a Siri (Apple), Google Now (Google/Android), S Voice (Samsung) e Cortana (Microsoft) --este último ainda não tem versão em português.

Não deixe de ler: 6 links que provam que o Google sabe tudo sobre você

Era preciso treinar a assistente

Mas reagir às nossas solicitações faladas não é tão simples. A grosso modo, os assistentes pessoais usam o reconhecimento de voz para inserir dados no dispositivo e, por isso, precisam interpretar linguisticamente o que falamos. Também contam com acesso aos seus dados pessoais, buscas na internet e auxílio a outros aplicativos instalados no dispositivo.Redes neurais, que realizam conexões de dados de forma parecida com o sistema nervoso, também vêm sendo pesquisados para esse fim. Mas os estudos em reconhecimento de voz existem pelo menos desde os anos 30 pela Bell Labs, grande empresa de pesquisa dos EUA.

"No final da década de 80, os programas que utilizam redes neurais passaram a ser viáveis e, com eles, surgiu a possibilidade concreta de se desenvolver modelos computacionais para o reconhecimento de voz. Os primeiros sistemas eram muito limitados e exigiam treinamento do software, para que este se adaptasse ao seu usuário. O treinamento poderia ser algo demorado", diz Rosa Vicari, responsável pelo grupo de inteligência artificial da UFRGS (Universidade Federal do Rio Grande do Sul).

As tecnologias envolvendo voz também são um meio alternativo de comunicação para pessoas com necessidades especiais de ordem visual ou motora, capaz de tarefas como leitura automatizada de textos, por exemplo. "Atualmente, esse tipo de aplicação também já atingiu escala comercial, motivando o investimento de grandes empresas, devido a demanda cada vez maior. A realidade é que cada vez mais teremos interações humanos-máquinas através da voz", prevê Rosa.

Como será o amanhã?

Quando a Siri foi lançada, recebeu críticas: 46% dos donos de aparelhos iOS acreditavam que a empresa exagerou nas capacidades prometidas. Isso aparentemente foi resolvido e hoje a assistente da Apple é bem aceita, pesquisa do site Experts Exchange, aponta que a Siri é a preferida entre os norte-americanos e também bateu o desempenho da Google Now e Cortana em testes.Os vestíveis, o setor automotivo e a vindoura internet das coisas já olham pro futuro da voz enquanto ferramenta. Vários smartwatches das grandes marcas, como os da Apple, Samsung e Motorola, reconhecem as vozes de seus donos --até para compensar os diminutos teclados das suas telas.

O Brillo, sistema da Google com suporte a dispositivos como lâmpadas e fechaduras inteligentes, foi lançado no ano passado e permitirá uso da voz para executar comandos. A Apple lançou em 2014 o CarPlay, um sistema inteligente que liga iPhones a uma central multimídia dos carros e usa a Siri apara ajudar o motorista em trajetos, ligações telefônicas e outros comandos.

Porém, ainda estamos um pouco longe de usar só a voz para controlarmos tudo. As atuais tecnologias de voz precisam corrigir muitas falhas de compreensão. Além disso, levantam constantes debates sobre a privacidade dos dados coletados.

"As possibilidades são infinitas, mas estamos dando um passo de cada vez. Não há atalhos pois trata-se mais de um método artesanal do que de um típico esforço de codificação", disse ao UOL por e-mail Bharath Mohan, gerente de produto da Microsoft responsável pelo Cortana. Apple, Google e Samsung foram procurados para falar sobre o Siri, Now e S Voice, mas não falaram com a reportagem.

Aplicações atuais e futuras

Assistente pessoal em qualquer lugar

Desde 2011 a Siri auxilia os usuários de iPhones e iPads. Na esteira

dela veio a concorrência: Google Now (Google/Android), S Voice

(Samsung), Cortana (Microsoft), M (Facebook) e Echo (Amazon). O que elas

fazem? De um modo geral, são praticamente secretárias de bolso: a

partir de perguntas, frases e buscas via voz (ou teclado), trazem

informações relevantes para o cotidiano, como previsão do tempo, bolsa

de valores e trânsito; navegador em trajetos de carro; sugerem

restaurantes, lojas e serviços a partir de sua localização; realizam

buscas na internet; agendam compromissos; e interagem com outros

aplicativos. Habilitar o recurso de voz é opcional: o usuário deve ir

nas configurações do aparelho e confirmar se quer mesmo usar as

assistentes dessa forma. Os smartwatches também usam versões adaptadas

das assistentes pessoais.

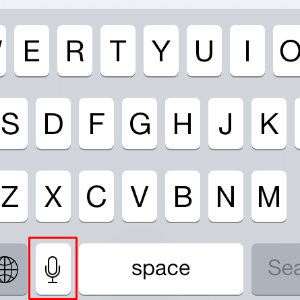

Escrever textos sem teclado

Seja para pessoas com deficiência ou para quem não quer mais usar

teclados físicos ou virtuais, a possibilidade de ditar um texto e

transformá-lo em frases prontas é uma mão na roda. No iOS, desde 2014 é

possível clicar no botão do microfone no teclado virtual e ditar o que

quiser em português, com direito a pontuação. O Google Now também faz

isso, mas no momento, só há suporte para esse tipo de pontuação em

alemão, inglês, espanhol, francês, italiano e russo. E os demais apps de

voz em sua maioria só reconhecem bem o inglês.

Tradução simultânea

Em 2013, o aplicativo do Google Tradutor lançou uma atualização em que

era possível pessoas de diferentes línguas usarem o programa para

traduzir suas frases simultaneamente. Basta tocar em um botão com

microfone na interface do app e este faria o resto, mostrando e tocando o

áudio das traduções. Depois foi a vez do Skype fazer o mesmo, em 2014.

Ambos ainda não funcionam com a precisão esperada, mas são úteis nos

momentos mais "desesperados".

Controle da casa conectada

A Internet das Coisas é um conjunto de produtos e tecnologias em

desenvolvimento que pretendem funcionar e reagir de forma mais

inteligente aos nossos hábitos e necessidades, além de criar objetos e

ambientes que "conversam" entre si. Na prática, esse sistema conecta-se à

internet ou a redes privadas, unindo "gadgets" como computadores,

notebooks, tablets e celulares, além de televisões, geladeiras,

iluminação e automóveis. Uma prévia do que pode acontecer já pode ser

vista no uso do Kinect (foto), aparelho da Microsoft que funciona com o

videogame Xbox One. Quando o dono da casa falar na sala "Xbox, ligue", o

console se liga sozinho. E é possível configurar para ligar outros

dispositivos, como TV, home theater e receptor de TV a cabo.

"Chofer" do carro autônomo

Ford, Lexus, Hyundai, Chrysler, Honda e GM são algumas das montadoras

que já lançam ou prometem lançar carros com sistemas de comandos de voz,

seja sozinhos ou em parcerias com outras empresas. E já que possuem

"expertise" no assunto, as gigantes da tecnologia já estão dispostas a

participar desse mercado, com iniciativas como Carplay (Apple), Android

Auto (Google) e uma adaptação do Cortana para veículos (Microsoft). O

protótipo de carro autônomo do Google (foto) não usa voz porque

teoricamente não precisa: seus sensores, radares e computadores fazem

tudo sozinho. Mas como nos testes já apresentou problemas e acidentes,

comenta-se que o reconhecimento de voz surja para melhorar a relação do

carrinho com os "motoristas" humanos.

Interação completa com robôs

Pode ser que em breve aquilo que vemos em "Star Wars" se torne real.

Nos filmes, personagens humanos conversam livremente com os "dróides"

R2-D2, C-3PO e BB-8 como se fossem pessoas dotadas de plena compreensão.

Na verdade robôs como o Asimo (foto), da Honda, já fazem isso, mas de

forma limitada. Se a tecnologia chegar a um nível de sofisticação capaz

de entender e reagir a tudo que falamos, talvez teremos de fato um robô

humanoide em cada lar resolvendo as tarefas chatas que nós, humanos,

costumamos procrastinar... desde que eles não se chateiem nem se vinguem

de nós por isso.

O que falta?

Acompanhar a velocidade da fala

Quem usa as assistentes pessoais dos celulares já deve ter sentido:

quanto mais rápido você falar, maior a chance do programa entender tudo

errado. O que acontece é que enquanto falamos, o software precisa

processar em tempo real quais palavras foram ditas. A tecnologia atual é

até bem precisa, mas quando aceleramos o discurso, não apenas há menos

pausas que separam as palavras umas das outras, como também não as

pronunciamos tão bem. Isso acaba comprometendo o resultado. Mas

convenhamos: falar sempre pausadamente não é lá muito fluido no

cotidiano, então seria ótimo se os programas acelerassem sua capacidade

de compreensão com o passar do uso.

Compreender diferentes timbres e volumes de voz

Se diferentes pessoas falarem uma mesma frase para o mesmo assistente

pessoal, é possível que a Siri, Google Now e afins entendam essa frase

de formas diferentes, ou pelo menos não a entendam de primeira com todos

eles. O desempenho do reconhecimento de voz também pode variar conforme

timbres, volumes e ênfases dadas por cada interlocutor.

Entender sotaques e gírias regionais

Algumas gírias o Google Now entende bem, como a pernambucana "arretado"

ou a baiana "zoró". Mas se você tentar falar a interjeição gaúcha "bá,

chê", ele vai entender como "bate" ou "boot". "O desafio é desenvolver

sistemas de reconhecimento de voz que sejam precisos independentes das

características do falante, como sotaque nativo x estrangeiro, homem x

mulher x criança, fala coloquial x formal", diz Aline Villavicencio,

professora do grupo de inteligência artificial da UFRGS (Universidade

Federal do Rio Grande do Sul).

Melhorar no quesito multilíngua

Os atuais programas até aceitam mais de uma língua, mas patinam um

pouco na hora de distinguir de qual idioma é determinada palavra. E

quanto mais idiomas você colocar na mistura, mais difícil vai ser essa

separação. É um problema que atrapalha bastante aqueles que têm que

lidar com palavras, nomes e expressões em inglês no trabalho, ou para

falar termos estrangeiros que foram assimilados no nosso cotidiano, como

"mouse" e "dossiê".

Captar e interpretar o som em situações complexas

Ruídos externos estão entre os maiores inimigos do reconhecimento de

voz. A diferença entre usar uma assistente pessoal em um escritório em

silêncio e em uma rua com carros buzinando ou em uma sala com eco é

gritante: a precisão diminui, e o processamento do que foi dito tende a

ser bem mais lento. Evoluções nisso passariam não apenas pelo software,

que precisaria filtrar melhor as vozes dos demais barulhos, mas também

por microfones cada vez melhores em dispositivos móveis.

Pontuar e caprichar na gramática em textos longos

O recurso de voz dos iPhones já aceita pontuação. Se você disser: "Eu

amo você ponto", a frase sera escrita como "Eu amo você." No Google Now

isso só ocorre em algumas línguas, e o português ainda não está entre

elas. O fato é que pontuar com a voz ainda é um dilema, e o ideal mesmo é

que o locutor apenas consiga a pontuação com a entonação correta, como

ao falar a frase "Você vem hoje?" o sistema já colocar a interrogação

por si só. Outro problema é que os sistemas ainda não entendem tão bem

questões como sintaxe e concordância verbal em alguns casos. Você pode

falar "concordou" e ele entender "concordo", por exemplo.

Expandir vocabulário e aceitar neologismos

Em um teste informal no UOL, o Google Now transformou "imexível",

palavra maluca cunhada pelo ex-ministro Antônio Rogério Magri (foto), em

"inesquecível". E reverteu "Expelliarmus", um dos feitiços das

histórias de Harry Potter, como "italianos". Por mais memória ou auxílio

ao Google que tenham os sistemas de reconhecimento de voz, eles podem

se confundir nesses casos. Se você inventar uma palavra ou preferir uma

forma curiosa de escrever palavras antigas, como a popular na internet

"quenhe vc", corruptela de "quem é você?", não conte com a compreensão

total do reconhecimento de voz até que o tal termo esteja totalmente

difundido.

Usar sem parecermos bobos

Quando os celulares se tornaram populares, muita gente estranhou a nova

situação de pessoas "falando sozinhas" na rua. Se o uso das assistentes

pessoais e de outras formas de reconhecimento de voz se tornarem

imprescindíveis, essa sensação vai se repetir. Afinal, ainda é bem

esquisito ficar repetindo a mesma frase ou pergunta no meio da rua com o

celular apontado para a boca.

Saber quando não agir

Em 2014, o áudio de um anúncio de TV sobre o Xbox One acabava ativando o

videogame à revelia dos usuários, ao falar o comando "Xbox on". Esse é

um exemplo do que pode acontecer se ficarmos totalmente cercados de

diferentes tecnologias de reconhecimento de voz: algo que não era pra

ser contextualmente um comando para a máquina acabar ativando ou

desativando algo sem querer. É uma tarefa difícil para os

desenvolvedoras de inteligência artificial conseguirem "adivinhar" as

intenções do usuário ou saber quando agir ou não.

Garantir alguma privacidade

A questão da privacidade e segurança dos dados ainda preocupa nessa

seara. Afinal, se todo mundo ficar falando em voz alta com as máquinas,

quem garante que alguém mal intencionado não estará por perto ouvindo os

comandos para usá-los em crimes? Ou que uma assistente pessoal ativada o

tempo todo não ouve e grava absolutamente tudo que ouvimos? Pode

parecer paranoia demais, mas o CEO da Apple, Tim Cook, já se pronunciou

sobre a Siri dizendo: "A Apple não tem acesso aos dados. Por isso não há

preocupações com a privacidade para a maioria das pessoas, acho, quando

as informações são mantidas em seu dispositivo e estão protegidas com a

sua senha". Será?

Via UOL Tecnologia

Nenhum comentário:

Postar um comentário